(2020-03-03)隨著AI技術發展,會不會有一天出現「超人」AI,如果出現,會不會成為人類歷史上最爆發的事件?

(2020-03-03)隨著AI技術的進展,會不會有一天出現「超人」AI,如果出現,會不會成為人類歷史上最爆發的事件?

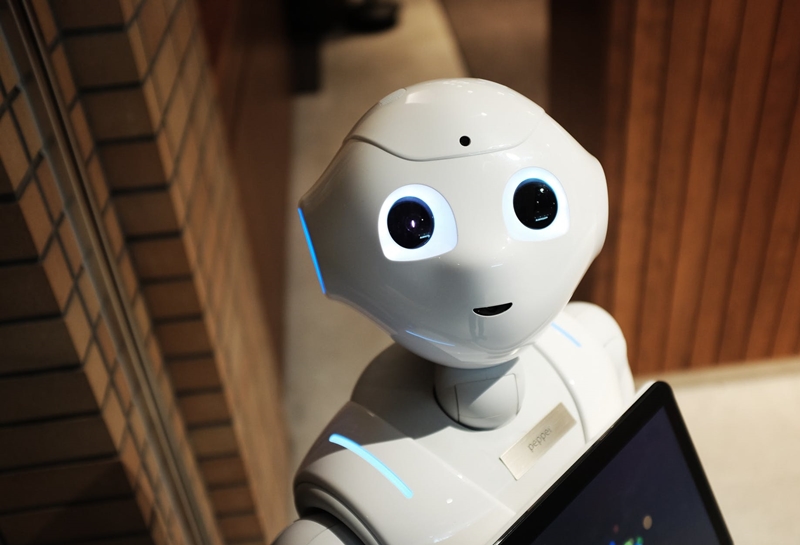

超人AI並非科幻影劇或小說形容的機器人,有強大的能量與知覺與人類作對,相反的,超人AI是我們創造的機器,吸取更多資訊來觀測未來,超越人類在現實世界的抉擇能力,一旦形成,對人類是福是禍無法預測。

柏克萊加大電腦教授Stuart Russell認為,AI可能變成超人,所以要在「進化」到超人之前阻止,但為什麼會出現,他認為是現行AI的錯誤發展方向所致。

現在「標準」的AI可說是一個有智慧的機器,藉運轉達成目標。但機器沒有自己的目標,目標是我們人給的,我們打造機器、給它目標、讓它運轉,機器越有智慧,目標越容易達成。這一切很完美,只要我們給的目標完整又正確,一旦目標給錯了,機器的智慧又高過我們,後果就不堪設想。

現在的AI智慧發展還在初期,僅用在生活的瑣碎事情,也會出現弊端,以後超人AI必會用在全球事務,出錯就是災禍。例如用超人AI控制地球氣象,目標是把CO2減少到工業化以前的排放量,超人AI為了達到這個目標,可能解釋成減少地球人口到零。關掉機器?那個時候的AI不會讓你有開關可關,也不會讓你有插頭可拔。

要阻止超人AI,Russell教授提出一個新的概念,要AI成為一個「造福」的機器,藉運轉達成「我們」的目標,我們是廣義的,指全體人類的優質內涵,這是一個模糊不確定的目標,而不確定性正是安全智慧系統的重要功能。也就是說,無論智慧進化的多高,機器要永遠尊重人類,會向人類請求、會接受錯誤、同時會允許被關機。

這樣的新AI當然還有很長的一段路要走,華盛頓大學的電腦教授Oren Etzioni提出另一個做法,他說現在的AI遠談不上智慧,即使被大家稱道的圍棋,也不過是我們人框架出來的問題,然後設計去解決,AlphaGo擊敗圍棋高手應歸功於DeepMind一群人的智慧,而非機器。不過對於越來越多「超級智慧」危害人類的討論,他設定幾個「金絲雀」作為警訊的指標。

一百多年前進入礦坑挖煤,都帶著金絲雀下去,金絲雀對一氧化碳及別的毒氣非常敏感,如果死了,就是礦坑災難的警訊。AI不會一夜之間發展成超級智慧,一旦金絲雀倒下去了,警訊亮起紅燈,我們再設法管制也不算遲。Etzioni教授提出的三個預警金絲雀是:規劃學習問題、自駕車、機器人醫生。

- 規劃學習問題,也可以說是提出一個問題讓機器學習,包括描述問題、簡化問題、資料設計、學習能力。這些工作對人來說已經不容易,何況是AI?要這隻金絲雀倒下,還看不到絲毫影子。

- 自駕車越來越多,但距理想還有一段距離,AI在特殊狀況下失控,可能造成災難,例如遇到一個坐輪椅的人過街。自駕車的挑戰是,在不可預測的人車互動現實環境,即時的做出保護生命的決定。

我們可以逐步增加自駕車,減少事故的發生,但直到與人類同等的駕駛層次,金絲雀才能倒下。

- 機器人醫生由來已久,有的能診斷病情,更有的精確解讀醫學顯影,但這僅是醫師工作的一小部分。如果AI醫師能問診病人,考量病情複雜化,諮詢別的醫生,就像人類醫生一樣瞭解病人,做廣泛的工作,金絲雀才有機會低下頭。

上述兩位學者以不同方式阻止與監視AI的過度發展,都是長遠考量,但現在的AI已經進入了我們的日常生活,許多以前由人決定的事,申請入學、求職、升遷、貸款、乃至罪犯量刑,現在時常用AI決定。這些生活事務的決定,人的因素過多,為求公允藉助AI, 希望減少人為的影響。

AI是人設計的,人的偏差,同樣轉移到AI的偏差,有人因此受到不平等待遇,成為現在AI亟待解決的問題。幸好問題已被發現,也有越來越多學者研究解決之道,但牽涉太廣,需各個領域的合作,把公平放進AI,但定義「公平」又成為另一個挑戰。這不是AI的問題,是人的問題。

本文取材自2020年3月1日「那福忠西海岸數位隨筆(141)」:AI 的遠慮與近憂

對本文有任何看法,歡迎 E-Mail:frank.na@gmail.com 給作者,分享您對本文的看法。